LLMと生成AIの違いとは?定義や関係性を初心者向けに徹底解説

公開日: 2025.11.19

近年、「生成AI」や「LLM(大規模言語モデル)」という言葉を耳にする機会が急速に増えました。特にChatGPTなどの登場により、AIが文章や画像を自動で作り出す時代が現実となっています。しかし、その一方で「LLMと生成AIは同じ意味なのか?」「どちらがChatGPTの正体なのか?」と疑問を持つ方も多いのではないでしょうか。

実は、LLMと生成AIは密接に関係しているものの、同じものではありません。LLMは言語を理解し生成する“基盤技術”であり、生成AIはそれを利用して実際にコンテンツを生み出す“応用システム”です。この違いを理解することで、AI技術の仕組みやビジネス活用の可能性がより明確になります。

本記事では、LLMと生成AIの定義から仕組み、そして両者の関係性を具体例や図解を交えてわかりやすく解説します。AIの進化を正しく理解し、今後の活用に役立つ知識を身につけましょう。

目次

LLMと生成AIの違いをひとことで言うと

AIの進化を語るうえで欠かせないのが「LLM(大規模言語モデル)」と「生成AI」という2つのキーワードです。どちらも似た文脈で使われるため混同されがちですが、厳密には役割が異なります。

結論から言うと、LLMは“生成AIを動かすためのエンジン”であり、生成AIは“そのエンジンを活用してコンテンツを作るシステム”です。 つまり、LLMがなければ多くの生成AIは成り立ちません。

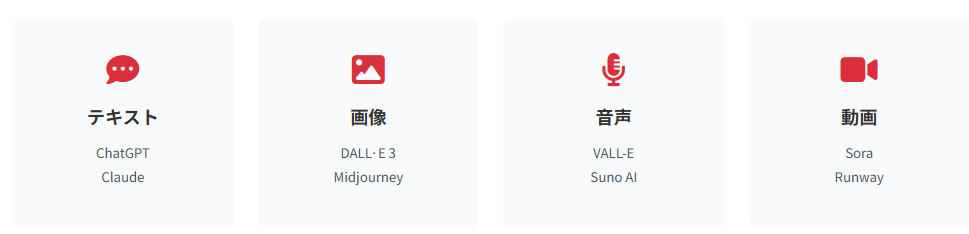

LLMは、大量のテキストデータを学習し、人間のように自然な文章を理解・生成できるAIモデルです。ChatGPTやClaude、GeminiといったAIは、すべてこのLLMを基盤に構築されています。一方、生成AIは文章生成だけでなく、画像・音声・動画など多様な形式のコンテンツを生み出す技術全般を指します。

たとえば、ChatGPTは「LLMを搭載した生成AI」ですが、画像生成ツールの「DALL·E」や音声合成ツールの「VALL-E」は、言語以外の領域に特化した生成AIです。このように、LLMは生成AIの一種ではなく、生成AIを支える“中核技術”のひとつとして位置づけられます。

そもそもLLM(大規模言語モデル)とは?

LLM(Large Language Model)は、「大量のテキストデータを学習して、言葉の意味や文脈を理解し、自然な文章を生成できるAIモデル」です。人間が文脈をもとに次の言葉を予測して話すように、LLMも「次に来る単語を高精度に予測する」ことで文章を作ります。

LLMの基本構造と仕組み

LLMの中心にあるのは「ニューラルネットワーク」という仕組みです。これは人間の脳の神経回路を模倣した構造で、数百億〜数兆のパラメータ(重み付け)を用いて、入力されたテキストから意味関係を学習します。学習に使われるデータは、インターネット上の公開情報や書籍、論文など膨大な量に及びます。

トークンとパラメータの関係

LLMは文章を「トークン」と呼ばれる単位に分解して扱います。たとえば「AIはすごい」という文は「AI」「は」「すご」「い」のように複数のトークンに分割されます。モデルはそれぞれのトークンのつながりを確率的に予測し、最も自然な文章を出力します。この精度を決めるのが「パラメータ」の数です。

代表的なLLMの例

- GPTシリーズ(OpenAI):ChatGPTの基盤モデル。汎用性が高く、幅広い分野に対応。

- Claude(Anthropic):安全性と倫理性に重点を置いた設計。

- Gemini(Google DeepMind):検索連携やマルチモーダルに強み。

- LLaMA(Meta):オープンソース型LLMとして開発者に人気。

これらはいずれも「Transformer」という構造を採用しており、文章の前後関係を深く理解できる点が特徴です。LLMは単なるテキスト処理技術ではなく、人間の思考に近い形で情報を理解し、表現する“言語理解エンジン”なのです。

生成AIとは?できることと種類

生成AI(Generative AI)とは、「新しいコンテンツを自動的に生み出す人工知能」を指します。従来のAIが「与えられたデータを分析・分類する」ことに特化していたのに対し、生成AIは「まったく新しい文章・画像・音声・動画などを作り出す」点に大きな特徴があります。

たとえば、テキスト生成AIであるChatGPTは文章を、画像生成AIのDALL·Eはイラストや写真を、音声生成AIのVALL-Eは人の声を、そして動画生成AIのSoraは映像を自動生成します。このように、生成AIは「クリエイティブな成果物を出力できるAI」として、クリエイティブ業界やビジネス現場に急速に普及しています。

生成AIの定義と目的

生成AIの目的は、人間の発想や表現を支援・拡張することにあります。大量の学習データをもとにパターンを理解し、「新しいパターン」を生成することで、コピーではなく“創造的出力”を実現します。文章であれば自然な流れや文体を、画像であれば構図やテクスチャを学び、オリジナルなアウトプットを生み出します。

文章・画像・音声などの生成AIの種類

-

テキスト生成AI(例:ChatGPT、Claude)

自然言語を理解し、質問応答や要約、記事作成などに活用されます。 -

画像生成AI(例:DALL·E、Stable Diffusion)

文章から画像を作り出す技術。広告やデザイン制作の現場で注目。 -

音声生成AI(例:VALL-E、Coqui TTS)

音声合成やナレーション生成に利用され、メディア制作に応用。 -

動画生成AI(例:Runway、Sora)

映像を自動生成し、映像制作のコスト削減を可能にします。

生成AIを支える技術要素

生成AIの基盤には「ディープラーニング(深層学習)」があり、その上に「Transformer構造」や「自己回帰モデル」などの手法が組み合わさっています。これにより、AIは文脈理解や画像構成の一貫性を保ちながら、より自然で創造的な成果物を生成できるようになっています。

生成AIは単なるツールではなく、「AIが人間の創造力を拡張するためのプラットフォーム」として今後ますます重要性を高めていくでしょう。

LLMと生成AIの違いをわかりやすく比較

「LLMと生成AIはどう違うのか?」という質問は非常に多く寄せられます。両者は密接に関連しており、明確な線引きが難しいためです。簡単に言えば、LLMは生成AIを動かす“脳”であり、生成AIはその脳を使って実際に何かを生み出す“アプリケーション”です。

役割・仕組み・用途の違い

-

LLM(大規模言語モデル)

→ 言語を理解・生成するためのAIモデル。大量のテキストを学習し、人間のような言葉の流れを予測できる。 -

生成AI

→ LLMなどのAIモデルを活用して、文章・画像・音声などのコンテンツを実際に生成する仕組み。

つまり、LLMは「頭脳部分」であり、生成AIは「実行部分」です。ChatGPTを例にすると、内部のモデルである「GPT-4」がLLM、実際にユーザーが会話するインターフェースが生成AIです。

LLMは生成AIの「中核技術」

生成AIの多くは、内部にLLMを搭載しています。特に自然言語を扱うテキスト生成AIでは、LLMが文脈を理解し、論理的な文章を作るための中心的役割を果たします。

一方で、画像や音声生成AIの場合は、言語以外のデータ(画像ピクセル、音声波形など)を学習する専用モデルを使用します。そのため、すべての生成AIがLLMを使っているわけではないのもポイントです。

LLMは「テキストの意味を理解するAI」、生成AIは「その理解をもとに表現を生み出すAI」と考えると整理しやすいでしょう。

| 項目 | LLM(大規模言語モデル) | 生成AI |

|---|---|---|

| 主な目的 | 言語を理解・生成する | コンテンツを生成する |

| 対応分野 | テキスト中心 | テキスト・画像・音声・動画など多様 |

| 主な例 | GPT-4、Claude、Gemini | ChatGPT、DALL·E、Midjourney |

| 技術基盤 | Transformer・自己回帰モデル | LLM+生成アルゴリズム |

| 入力 | テキスト | テキスト・画像・音声など |

| 出力 | 文章 | 文章・画像・音声・動画など |

| 位置づけ | 技術(基盤) | 応用(アプリケーション) |

このように、両者は「技術層」と「応用層」という関係にあります。LLMが進化すれば、生成AIの表現力や正確性も向上します。逆に、生成AIが広く活用されることで、LLMの需要と改良も加速します。

両者は対立する概念ではなく、「基盤と応用」「技術と活用」という補完的な関係にあるのです。

ChatGPTはどちら?LLMと生成AIの関係を具体例で解説

ChatGPTは、LLMと生成AIの関係を理解するうえで最もわかりやすい実例です。多くの人がChatGPTを使って「文章を生成するAI」と認識していますが、正確には 「LLMを活用した生成AI」 です。

ChatGPTが動作する仕組み

ChatGPTの内部では、OpenAIが開発した「GPT(Generative Pre-trained Transformer)」というLLMが動いています。このモデルは数兆単語にも及ぶ膨大なテキストを学習しており、文脈を理解しながら次の言葉を予測する能力を持ちます。

ユーザーが質問を入力すると、ChatGPTはその文章をトークン単位で解析し、最も自然な返答を確率的に生成します。

この「学習済みモデル(GPT)」が LLM にあたり、

それをAPIやUIを通じてユーザーが操作できるようにしたものが 生成AI(ChatGPT) です。

ChatGPTは「LLMを活用した生成AI」である理由

ChatGPTの生成力は、LLMによって支えられています。しかし、ChatGPT自体は単なるモデルではなく、

- 会話履歴を保持するUI設計

- 安全性・倫理性を保つフィルタリング

- 人間との自然な対話を実現するチューニング(RLHF)

など、実用化のためのアプリケーション層を備えています。

つまり、LLM(GPT)が「知能」にあたるなら、ChatGPTは「それを使いやすくしたサービス」です。

この構造は、車で例えると「エンジン(LLM)」と「車体(生成AI)」の関係に近いと言えるでしょう。

LLMの仕組みをもう少し深く理解する

LLMは「言語を理解し、文脈に沿った文章を生成できるAIモデル」ですが、その内部は非常に高度な仕組みで成り立っています。ここでは、LLMを支える3つの主要技術 ― ニューラルネットワーク、Transformer、自己回帰モデル ― を中心に解説します。

ニューラルネットワークとTransformerの関係

LLMの根幹にあるのが「ニューラルネットワーク(Neural Network)」です。これは、人間の脳の神経細胞を模倣した構造で、入力データを多層のノードを通して解析し、最適な出力を導き出します。

中でもLLMでは、Transformer構造というアーキテクチャが採用されています。Transformerは2017年にGoogleが発表したもので、「Attention(注意機構)」によって文脈全体を俯瞰的に理解できる点が特徴です。

従来のRNN(再帰型ニューラルネットワーク)では、文の順番どおりに情報を処理していましたが、Transformerは文全体の関係性を一度に把握できるため、長文でも文脈を失わずに処理できます。この構造こそが、ChatGPTのような自然で一貫性のある文章生成を可能にしているのです。

自己回帰型モデル(Auto-regressive)とは

LLMは「自己回帰型モデル」と呼ばれる生成方式を採用しています。これは、文章を1トークンずつ生成しながら、次に来る単語を確率的に予測していく仕組みです。

たとえば、「今日は天気が…」と入力された場合、モデルは学習データをもとに「良い」「悪い」「晴れ」などの候補を評価し、最も確からしい語を選択します。その結果を次の予測の入力として再利用し、自然な文章を連続的に作り出します。

訓練データの重要性と限界

LLMの性能は、どれだけ多様で高品質なデータを学習しているかに大きく左右されます。ニュース記事、論文、SNS投稿など、数兆単語規模のテキストを学習することで、言語の構造や世界知識を獲得します。

しかし、学習データが偏っていたり、古い情報しか含まれていない場合、誤った回答やバイアスを生むリスクもあります。そのため、モデル開発者は「データの選定」「更新」「倫理的フィルタリング」を慎重に行っています。

LLMの仕組みを理解すると、単に「すごいAI」という印象から、「どうやって賢くなっているのか」「どこに限界があるのか」を正しく判断できるようになります。

生成AIとLLMの関係性をビジネス視点で理解

技術的な理解を深めたところで、ここでは「LLMと生成AIがビジネスの現場でどのように結びついているのか」を解説します。両者の関係を正しく理解することは、AI導入の戦略を立てるうえで非常に重要です。

生成AI活用の中心にあるLLM

現代の多くの生成AIサービスは、内部にLLMを搭載しています。特にテキストを扱う分野では、LLMが“言語理解の心臓部”として機能しています。

例えば、

- カスタマーサポートの自動応答:質問意図を理解して最適な回答を生成

- 社内ナレッジ検索:社内ドキュメントを自然文で問い合わせ

- マーケティング支援:文章構成やコピー作成を自動化

これらはすべて、LLMが自然言語を的確に解釈し、文脈に合った文章を生成できるからこそ成立しています。

LLMがもたらす業務自動化・効率化の実例

-

ドキュメント作成の自動化

報告書や議事録を生成AIが自動作成し、作業時間を大幅に短縮。 -

営業メール・提案書のドラフト生成

ターゲット情報を入力するだけで、最適な文面を提案。 -

プログラムコード生成(例:GitHub Copilot)

自然言語からコードを生成し、開発者の生産性を高める。 -

顧客対応チャットボットの高度化

FAQベースではなく、文脈を理解した対話が可能に。

これらの業務効率化は単なる自動化ではなく、「人間の思考を補助し、より創造的な仕事に集中できる環境」を生み出すという点で本質的な変化をもたらしています。

LLMを使う際の課題(精度・倫理・著作権)

ビジネス活用においては、次のような課題にも注意が必要です。

- 精度の限界:誤った情報を出す可能性(いわゆる“ハルシネーション”)がある

- 倫理的懸念:偏見を含んだ出力やセンシティブな情報生成のリスク

- 著作権問題:学習データに既存コンテンツが含まれる場合の法的課題

これらを回避するために、多くの企業では「社内専用LLM」や「クローズドデータ学習型生成AI」の導入を進めています。つまり、オープンAIの力を活かしつつ、自社データで安全に運用するという方向性です。

生成AIの価値は、単に文章や画像を生成することではなく、「人の判断を支援する知的な補助ツール」として活用する点にあります。

生成AIの進化とLLMの今後

生成AIとLLMの発展は、ここ数年で驚くほどのスピードで進んでいます。ChatGPTの登場以降、AIは単なる自動化ツールではなく、人間の思考や創造性を支援する「知的パートナー」として社会に浸透し始めています。ここでは、現在の進化の方向性と今後の展望を整理します。

マルチモーダルAIの登場

これまでのLLMはテキストを中心に扱っていましたが、近年は「マルチモーダルAI」と呼ばれる、テキスト・画像・音声・動画など複数の情報形式を統合的に理解・生成するAI が登場しています。

たとえば、OpenAIのGPT-4VやGoogleのGeminiは、画像を読み取りながら文章を生成したり、音声入力を解析してテキストを返したりといった高度な処理を実現しています。

この技術の進化により、AIはより人間に近い「五感的理解力」を備えつつあります。

LLMの軽量化・専門特化のトレンド

これまでのLLMは数百GB〜数TB規模と非常に巨大で、運用コストが高いことが課題でした。現在は、軽量で専門分野に特化した“小型LLM” が次々と登場しています。

たとえば、企業内ドキュメントや特定業界の知識だけを学習した「ドメイン特化型LLM」は、汎用モデルよりも正確な回答を返すケースが増えています。

また、オープンソースモデル(例:LLaMA、Mistralなど)を基に、自社専用LLMをカスタマイズする動きも活発です。これにより、企業が自前でAI技術をコントロールできる時代が近づいています。

今後求められるAIリテラシーとは

AIの進化に伴い、今後は「誰がAIを使えるか」ではなく、「どう使いこなせるか」が重要になります。

単にツールとして利用するだけでなく、AIの出力を正しく評価し、倫理的に扱うスキル=AIリテラシー が不可欠です。AIを信頼するためには、LLMの仕組みや限界を理解し、人間の判断と組み合わせて使うことが求められます。

LLMと生成AIは今後も相互に進化を続け、より人間らしい知的処理を担う存在になっていくでしょう。次章では、初心者でも体験できる具体的なツールや学習方法を紹介します。

初心者でも理解できるLLM・生成AIの体験方法

「理屈はわかったけれど、実際に触れてみないとイメージが湧かない」という方も多いでしょう。ここでは、専門知識がなくてもLLMや生成AIを体験できる方法を紹介します。実際に試すことで、AIの動作原理や限界、活用の可能性を体感できます。

無料で試せる生成AIツール

まずは、ブラウザやスマートフォンから手軽に使える代表的なサービスを紹介します。

ChatGPT(OpenAI)

最も有名なテキスト生成AI。質問応答や文章作成、翻訳、要約など多用途に対応。

公式サイト:https://openai.com/ja-JP/

Gemini(Google)

Googleアカウントで利用可能な会話型AI。検索との連携が強み。

公式サイト:https://gemini.google.com/?hl=ja

Claude(Anthropic)

文脈理解に優れ、安全性が高いLLMベースのAI。長文処理が得意。

公式サイト:https://claude.ai/

DALL·E/Bing Image Creator

テキストから画像を生成できるAI。デザイン初心者でもクリエイティブ表現が可能。

公式サイト:https://openai.com/ja-JP/index/dall-e-3/

Perplexity AI

情報検索とLLMを組み合わせた回答型AI。出典付きで信頼性が高い。

公式サイト:https://www.perplexity.ai/

これらのツールは、登録さえすれば誰でもすぐに無料で体験できます。

学習におすすめの情報源・教材

生成AIやLLMを深く理解するには、体験と同時に知識を整理することが大切です。

- YouTube講座:「AI解説チャンネル」や「Tech系教育系チャンネル」では実例ベースの解説が豊富。

- 書籍:『生成AIの教科書』『ChatGPTのしくみ』など入門書が多数出版。

- オンライン学習サイト:UdemyやCourseraでは、LLMの仕組みを実践的に学べる講座も。

これらを通じて学習を進めることで、「LLM=AIの頭脳」「生成AI=その応用」という構造が自然に理解できるようになります。

まとめ:LLMと生成AIの違いを正しく理解して使いこなそう

ここまで、LLMと生成AIの定義や仕組み、関係性を詳しく解説してきました。改めて整理すると、LLMは言語を理解し生成する「技術基盤」、そして生成AIはその基盤を応用して実際にコンテンツを生み出す「実用システム」です。両者は階層的な関係にあり、互いに切り離して語ることはできません。

ChatGPTを例にとると、内部で動く「GPT-4」がLLM、そして私たちが利用している「ChatGPT」という対話型アプリケーションが生成AIです。この構造を理解することで、AIを単なるツールとしてではなく、仕組みを踏まえて正しく評価・活用できるようになります。

今後は、テキストだけでなく画像・音声・動画を統合的に扱うマルチモーダルAIが主流になると考えられます。ビジネス現場では、これらの技術を「自社の課題解決にどう組み込むか」が重要です。

LLMや生成AIを使いこなすことは、もはや専門家だけの領域ではありません。文章作成、業務効率化、データ分析など、あらゆる職種でAIを“共働者”として活用する力が求められています。

AIの仕組みを理解し、正しく扱うリテラシーを身につけることが、今後の時代を生き抜く最も重要なスキルになるでしょう。

現在デジタルマーケティングにおいてお悩みがある方や、

課題を感じているがどうしていいかわからない方向けに

無料でご相談会を実施しております。

まずは自社の現状を知り、可能な改善施策はどういったものがあるのか、

スケジュール、予算感はどのようなものなのか等も含めて

ご説明しますので、お気軽にご相談ください。

監修者プロフィール

-

セミナー

さらに学びたい方や、弊社のサービスについて知りたい方向けに通常セミナーや、時間を限定しないオンデマンドセミナーを用意しています。

開催セミナー一覧 -

資料ダウンロード

デジタルマーケティングに関するお役立ち資料や、弊社サービス資料をダウンロードいただけます。

資料ダウンロード一覧 -

サービスの

お問い合わせセンタードのサービスに関するご質問やお見積もり、ご発注など様々なお問い合わせはこちらからお気軽にお願いします。

お問い合わせフォーム